Всем привет! Сегодня статья о том, каким должен быть правильный файл robots.txt для WordPress. С функциями и предназначением мы разбирались несколько дней назад, а сейчас разберём конкретный пример для ВордПресс.

С помощью этого файла у нас есть возможность задать основные правила индексации для различных поисковых систем, а также назначить права доступа для отдельных поисковых ботов. На примере я разберу как составить правильный robots.txt для WordPress. За основу возьму две основные поисковые системы — Яндекс и Google.

В узких кругах вебмастеров можно столкнуться с мнением, что для Яндекса необходимо составлять отдельную секцию, обращаясь к нему по User-agent: Yandex . Давайте вместе разберёмся, на чём основаны эти убеждения.

Яндекс поддерживает директивы Clean-param и Host , о которых Google ничего не знает и не использует при обходе.

Разумно использовать их только для Yandex, но есть нюанс — это межсекционные директивы, которые допустимо размещать в любом месте файла, а Гугл просто не станет их учитывать. В таком случае, если правила индексации совпадают для обеих поисковых систем, то вполне достаточно использовать User-agent: * для всех поисковых роботов.

При обращении к роботам по User-agent важно помнить, что чтение и обработка файла происходит сверху вниз, поэтому используя User-agent: Yandex или User-agent: Googlebot необходимо размещать эти секции в начале файла.

Пример Robots.txt для WordPress

Сразу хочу предупредить: не существует идеального файла, который подойдет абсолютно всем сайтам, работающим на ВордПресс! Не идите на поводу, слепо копируя содержимое файла без проведения анализа под ваш конкретный случай! Многое зависит от выбранных настроек постоянных ссылок, структуры сайта и даже установленных плагинов. Я рассматриваю пример, когда используется ЧПУ и постоянные ссылки вида /%postname%/ .

Как и любая система управления контентом, имеет свои административные ресурсы, каталоги администрирования и прочее, что не должно попасть в индекс поисковых систем. Для защиты таких страниц от доступа необходимо запретить их индексацию в данном файле следующими строками:

Disallow: /cgi-bin Disallow: /wp-

Директива во второй строке закроет доступ по всем каталогам, начинающимся на /wp- , в их число входят:

- wp-admin

- wp-content

- wp-includes

Но мы знаем, что изображения по умолчанию загружаются в папку uploads , которая находится внутри каталога wp-content . Разрешим их индексацию строкой:

Allow : */uploadsСлужебные файлы закрыли, переходим к исключению дублей с основным содержимым, которые снижают в пределах одного домена и увеличивают вероятность наложения на сайт фильтра со стороны ПС. К дублям относятся страницы категорий, авторов, тегов, RSS-фидов, а также постраничная навигация, трекбеки и отдельные страницы с комментариями. Обязательно запрещаем их индексацию:

Disallow: /category/ Disallow: /author/ Disallow: /page/ Disallow: /tag/ Disallow: */feed/ Disallow: */trackback Disallow: */comments

Далее хотелось бы уделить особое внимание такому аспекту как . Если вы используете ЧПУ, то страницы содержащие в URL знаки вопроса зачастую являются «лишними» и опять же дублируют основной контент. Такие страницы с параметрами следует запрещать аналогичным образом:

Disallow: */?

Это правило распространяется на простые постоянные ссылки?p=1 , страницы с поисковыми запросами?s= и другими параметрами. Ещё одной проблемой могут стать страницы архивов, содержащие в URL год, месяц. На самом деле их очень просто закрыть, используя маску 20* , тем самым запрещая индексирование архивов по годам:

Disallow: /20*

Для ускорения и полноты индексации добавим путь к расположению . Робот обработает файл и при следующем посещении сайта будет его использовать для приоритетного обхода страниц.

Sitemap: https://сайт/sitemap.xml

В файле robots.txt можно разместить дополнительную информацию для роботов, повышающую качество индексации. Среди них директива Host — указывает на для Яндекса:

Host : webliberty .ruПри работе сайта по HTTPS необходимо указать протокол:

Host: https://сайт

С 20 марта 2018 года Яндекс официально прекратил поддержку директивы Host. Её можно удалить из robots.txt, а если оставить, то робот её просто игнорирует.

Подводя итог, я объединил всё выше сказанное воедино и получил содержимое файла robots.txt для WordPress, который использую уже несколько лет и при этом в индексе нет дублей:

User-agent: * Disallow: /cgi-bin Disallow: /wp- Disallow: /category/ Disallow: /author/ Disallow: /page/ Disallow: /tag/ Disallow: */feed/ Disallow: /20 * Disallow: */trackback Disallow: */comments Disallow: */? Allow: */uploads Sitemap: https://сайт/sitemap.xml

Постоянно следите за ходом индексации и вовремя корректируйте файл в случае появления дублей.

От того правильно или нет составлен файл зависит очень многое, поэтому обратите особо пристальное внимание к его составлению, чтобы поисковики быстро и качественно индексировали сайт. Если у вас возникли вопросы — задавайте, с удовольствием отвечу!

Robots.txt создан для регулирования поведения поисковых роботов на сайтах, а именно куда им заходить можно и брать в поиск, а куда нельзя. Лет 10 назад сила данного файла была велика, по его правилам работали все поисковые системы, но сейчас он скорее как рекомендация, чем правило.

Но пока не отменили, вебмастера должны делать его и настраивать правильно исходя из структуры и иерархии сайтов. Отдельная тема это WordPress, потому что CMS содержит множество элементов, которые не нужно сканировать и отдавать в индекс. Разберемся как правильно составить robots.txt

Где лежит файл robots в WordPress

На любом из ресурсов robots.txt должен лежать в корневой папке. В случае с вордпресс, там где находится папка wp-admin и ей подобные.

Расположение на сервере

Если не создавался и не загружался администратором сайта, то по умолчанию на сервере не найти. Стандартная сборка WordPress не предусматривает наличие такого объекта.

Как создать правильный robots txt

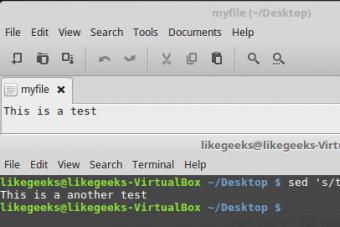

Создать правильный robots txt задача не трудная, сложнее прописать в нем правильные директивы. Сначала создадим документ, открываем программу блокнот и нажимаем сохранить как.

Сохраняем документ

Сохраняем документ В следующем окне задаем название robots, оставляем расширение txt, кодировку ANSI и нажимаем сохранить. Объект появится в папке куда произошло сохранение. Пока документ пустой и ничего не содержит в себе, давайте разберемся какие именно директивы он может поддерживать.

При желании можете сразу скачать его на сервер в корень через .

Сохранение роботса

Сохранение роботса Настройка команд

Выделю четыре основные команды:

- User-agent: показывает правила для разных поисковых роботов, либо для всех, либо для отдельных

- Disalow: запрещает доступ

- Allow: разрешаем доступ

- Sitemap: адрес до XML карты

Устаревшие и ненужные конфигурации:

- Host: указывает главное зеркало, стало не нужным, потому что поиск сам определит правильный вариант

- Crawl-delay: ограничивает время на пребывание робота на странице, сейчас сервера мощные и беспокоится о производительности не нужно

- Clean-param: ограничивает загрузку дублирующегося контента, прописать можно, но толку не будет, поисковик проиндексирует все, что есть на сайте и возьмет по–максимому страниц

Рабочий пример инструкций для WordPress

Дело в том что поисковой робот не любит запрещающие директивы, и все равно возьмет в оборот, что ему нужно. Запрет на индексацию должен быть объектов, которые 100% не должны быть в поиске и в базе Яндекса и Гугла. Данный рабочий пример кода помещаем в robots txt.

User-agent: * Disallow: /wp- Disallow: /tag/ Disallow: */trackback Disallow: */page Disallow: /author/* Disallow: /template.html Disallow: /readme.html Disallow: *?replytocom Allow: */uploads Allow: *.js Allow: *.css Allow: *.png Allow: *.gif Allow: *.jpg Sitemap: https://ваш домен/sitemap.xml

Разберемся с текстом и посмотрим что именно мы разрешили, а что запретили:

- User-agent, поставили знак *, тем самым сообщив что все поисковые машины должны подчиняться правилам

- Блок с Disallow запрещает к индексу все технические страницы и дубли. обратите внимание что я заблокировал папки начинающиеся на wp-

- Блок Allow разрешает сканировать скрипты, картинки и css файлы, это необходимо для правильного представления проекта в поиске иначе вы получите портянку без оформления

- : показывает путь до XML карты сайта, обязательно нужно ее сделать, а так же заменить надпись”ваш домен”

Остальные директивы рекомендую не вносить, после сохранения и внесения правок, загружаем стандартный robots txt в корень WordPress. Для проверки наличия открываем такой адрес https://your-domain/robots.txt, заменяем домен на свой, должно отобразится так.

Адрес в строке запроса

Адрес в строке запроса Как проверить работу robots.txt

Стандартный способ проверить через сервис yandex webmaster . Для лучшего анализа нужно зарегистрировать и установить на сайт сервис. Вверху видим загрузившийся robots, нажимаем проверить.

Проверка документа в yandex

Проверка документа в yandex Ниже появится блок с ошибками, если их нет то переходим к следующему шагу, если неверно отображается команда, то исправляем и снова проверяем.

Отсутствие ошибок в валидаторе

Отсутствие ошибок в валидаторе Проверим правильно ли Яндекс обрабатывает команды, спускаемся чуть ниже, введем два запрещенных и разрешенных адреса, не забываем нажать проверить. На снимке видим что инструкция сработала, красным помечено что вход запрещен, а зеленой галочкой, что индексирование записей разрешена.

Проверка папок и страниц в яндексе

Проверка папок и страниц в яндексе Проверили, все срабатывает, перейдем к следующему способу это настройка robots с помощью плагинов. Если процесс не понятен, то смотрите наше видео.

Плагин–генератор Virtual Robots.txt

Если не хочется связываться с FTP подключением, то приходит на помощь один отличный WordPress плагин–генератор называется Virtual Robots.txt . Устанавливаем стандартно из админки вордпресс поиском или загрузкой архива, выглядит так.

Как выглядит Virtual Robots.txt

Как выглядит Virtual Robots.txt Настройки > Virtual Robots.txt, видим знакомую конфигурацию, но нам нужно ее заменить, на нашу из статьи. Копируем и вставляем, не забываем сохранять.

Настройка Virtual Robots.txt

Настройка Virtual Robots.txt Роботс автоматически создастся и станет доступен по тому же адресу. При желании проверить есть он в файлах WordPress – ничего не увидим, потому что документ виртуальный и редактировать можно только из плагина, но Yandex и Google он будет виден.

Добавить с помощью Yoast SEO

Знаменитый плагин Yoast SEO предоставляет возможность добавить и изменить robots.txt из панели WordPress. Причем созданный файл появляется на сервере (а не виртуально) и находится в корне сайта, то есть после удаления или деактивации роботс остается. Переходим в Инструменты > Редактор.

Yoast SEO редактор файлов

Yoast SEO редактор файлов Если robots есть, то отобразится на странице, если нет есть кнопка “создать”, нажимаем на нее.

Кнопка создания robots

Кнопка создания robots Выйдет текстовая область, записываем, имеющийся текст из универсальной конфигурации и сохраняем. Можно проверить по FTP соединению документ появится.

Изменить модулем в All in One SEO

Старый плагин All in One SEO умеет изменять robots txt, чтобы активировать возможность переходим в раздел модули и находим одноименный пункт, нажимаем Activate.

Модули в All In one Seo

Модули в All In one Seo В меню All in One SEO появится новый раздел, заходим, видим функционал конструктора.

Работа в модуле AIOS

Работа в модуле AIOS - Записываем имя агента, в нашем случае * или оставляем пустым

- Разрешаем или запрещаем индексацию

- Директория или страница куда не нужно идти

- Результат

Модуль не удобный, создать по такому принципу валидный и корректный robots.txt трудно. Лучше используйте другие инструменты.

Правильная настройка для плагина WooCommerce

Чтобы сделать правильную настройку для плагина интернет магазина на WordPress WooCommerce, добавьте эти строки к остальным:

Disallow: /cart/ Disallow: /checkout/ Disallow: /*add-to-cart=*

Делаем аналогичные действия и загружаем на сервер через FTP или плагином.

Итог

Подведем итог что нужно сделать чтобы на сайте WordPress был корректный файл для поисковиков:

- Создаем вручную или с помощью плагина файл

- Записываем в него инструкции из статьи

- Загружаем на сервер

- Проверяем в валидаторе Yandex

- Не пользуйтесь генераторами robots txt в интернете, пошевелите немного руками

Совершенствуйте свои блоги на WordPress, продвигайтесь и правильно настраивайте все параметры, а мы в этом поможем, успехов!

Привет! В данной статье пойдёт речь о том, как создать файл robots.txt для wordpress. Также узнаем, как настроить файл robots.txt.

Это очень важный файл для сайтов и блогов. Он показывает роботам поисковых систем, что и как нужно индексировать на Вашем блоге.

Этот тот самый файл, который нужно настроить одним из первых на блоге. Его отсутствие или пренебрежительное отношение к нему — это одна из главных ошибок блоггеров- новичков.

Как создать файл robots.txt для wordpress.

Файл robots.txt, так же, как и карта сайта sitemap.xml, предназначены для управления индексацией. Первым делом правильно пропишем в файле robots.txt правила для поисковиков. А затем добавим папку с файлом в корневой каталог. Делается это легко на раз два. И тогда робот будет подчиняться Вашим правилам. А именно, он поймет, что ему индексировать, а что не стоит. Вы сами пропишите эти правила. Безусловно, это повлияет на успешное продвижение сайта.

Нужно понимать, что не все файлы, находящиеся на блоге или в корневом каталоге нужно индексировать поисковыми системами. Разберем этот вопрос по- подробней. Корневой каталог это не что иное, как основная папка вашего сайта со всеми файлами, будь то видео аудио и картинки, то есть все до последнего файла, находящегося на Вашем блоге(его содержимое). В зависимости от того какой у Вас хостинг, это будет или httpdocs или public_html. Но суть одна. Запомните это!

Все блоги и сайты на wordpress имеют папки и файлы, обусловленные самим движком. Кто не знает что такое движок, поясняю. Движок- это конструктор хоста или хостинга. Или по другому, это система управления хостингом. Вот пример. Система управления хостингом TimeWeb — есть WordpRess. Другими словами -это огромный конструктор без которого Вы не сможете работать на хостинге. Конструкторы или движки бывают разные, но WordPress наиболее известный и популярный.

Поисковые роботы, зайдя на Ваш сайт будут индексировать все подряд.

Поэтому им нужно указать, что индексировать, а что не нужно. Теперь понимаете, для чего нам нужен файл robots.txt. А как запретить роботам индексацию, иначе поисковые роботы, зайдя на ваш ресурс, будут индексировать все, что попадется на их пути.

Дело в том, что лимит есть и у поисковых систем. Оставив без внимания настройку файла robots.txt Вы рискуете обрасти дублированным контентом и быть не проиндексированными там где это необходимо. Поисковики этого очень не любят и как следствие наложение фильтра на Ваш сайт или АГС. То есть Ваш сайт попадает в черный список неблагонадежных из за нерадивого хозяина.

Где появляются дубли страниц? Дублями страниц в wordpress в основном выступают рубрики, архивы и метки. Если их не закрывать от индекса, тогда их расплодится очень много и со стремительной скоростью. Чтобы этого не случилось для движка wordpress существует плагин поисковой оптимизации All In One SEO Pack. Он при правильной его настройке предотвращает все неприятности связанные с этим явлением как дубли.

Еще очень Важно!!! Если Вы добавляете в корень сайта (каталог) папки с файлами, в которых много внешних ссылок или скриптов, тогда нужно не забывать их обязательно закрывать от индексации в файле robots.txt. Читем дальше, как это сделать легко и просто.

Настройка robots.txt

Robots.txt это обычный файл txt он составляется в обычной программе блокнот или в текстовом редакторе notepad++ и включает несколько важных директив. Первая самая важная User-agent. Это попросту говоря обращение к поисковому роботу. Чтобы обратиться ко всем поисковым роботам, которые будут заходить к вам на блог необходимо в самом начале документа прописать эту фразу:

Директива Disallow это значит запретить, а директива Allow:/ разрешить

И так наш документ имеет такой вид:

Disallow:

Добавим к Disallow правый слэш «/»:

И документ выглядит так:

User-agent: *

Disallow: /

Это означает запрет всем поисковым системам индексировать Ваш сайт.

Но весь сайт запрещать индексировать не нужно, иначе, зачем нам такой сайт.

Поэтому внимательно прописываем запрет только тех папок, которые индексировать мы не хотим. Например, папка wp-admin

Тогда прописываем следующее:

User-agent: *

Disallow: /wp-admin

Друзья, я Вас долго не буду мучить и дам Вам правильный файл robots.txt для wordpress, рекомендуемый разработчиками. Но сначала дочитайте статью до конца.

А сейчас рассмотрим еще очень важную директиву Host. Эта директива Host -предназначена только для поисковика Яндекс. Дело в том, что это правило придумал сам Яндекс. Поисковая система Яндекс имеет большой вес в русскоязычном интернете и это явилось важным фактором или капризом. Но это должно выполняться и все без возражений и обсуждений.

Также Яндекс требует выделить отдельный блок для себя и выглядит он так:

User-agent: Yandex

Уясните это к сведению), что во избежание неправильной индексации блога или сайта, директива Host прописывается для Яндекса.

Она указывает на основное зеркало ресурса, то есть адрес по которому будет доступен Ваш сайт:

Другие поисковики не понимают директиву Host!

И так для Яндекса этот блок в файле robots.txt должен выглядеть так:

User-agent: Yandex Disallow: Host: www.sait.ru или User-agent: Yandex Disallow: Host: sait.ru

Рассмотрим последнюю директиву, которую включает правильный robots.txt для wordpress. Она имеет знакомое название, sitemap.

Это не что иное, как карта сайта для роботов или sitemap.xml У меня по этому поводу есть статья.

Эта важная директива Sitemap, которая указывает роботам на место, где расположена карта Вашего сайта. Она прописывается отдельно от предыдущих директив один раз. Ее понимают все поисковые роботы без исключения и такой главный робот как Google. Это выглядит так:

Мы тут рассмотрели основные директивы, которые нужно использовать в правильном robots.txt

Пример правильного файла robots.txt. У меня это так:

User-agent: *

Allow: /

Disallow: /jexr

Disallow: /cgi-bin

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /feed/

Disallow: */feed

Disallow: /trackback

Disallow: */trackback

Disallow: /category/*/*

Disallow: */comments

User-agent: Yandex

Disallow: /cgi-bin

Disallow: /wp-content/plugins

Disallow: /wp-content/cache

Disallow: /wp-content/themes

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /feed/

Disallow: */feed

Disallow: /trackback

Disallow: */trackback

Disallow: /category/*/*

Disallow: */comments

Host: сайт

Sitemap: http://сайт/sitemap.xml

Смело копируйте, только впишите свое доменное имя.

Вот этот пункт, Disallow: /jexr/(который выделен желтым) вставляете если у Вас на блоге установлен плагин (J) ExR

Выводы:

Что необходимо скормить поисковым роботам в первую очередь для индексации- конечно это Ваш уникальный контент. Что Вы получаете?

Ваш блог на wordpress будет правильно и быстро индексироваться. И не одна Ваша статья не останется без внимания. Поисковые роботы не будут тратить время на не нужный контент.

Я изучала и сравнивала множество файлов robots.txt на разных блогах wordpress. Они все примерно одинаковы.

Как проверить и посмотреть, как выглядит robots.txt с другого ресурса, нужно прописать в строке браузера, после доменного имени через слеш (/) файл /robots.txt.

Пример: сайт/robots.txt

Важно! Имя файла должно быть всегда одинаковым! Это выглядит так:

robots.txt

Это Важно.

Никаких заглавных букв не должно быть. А на конце не забывайте писать "s". Смело копируйте файл robots.txt, который я Вам дала выше. Только не забудьте поменять мои данные на свои. И загрузите (robots.txt), в корневой каталог. Я это делаю через программу filezilla. Она проста и удобна. Как пользоваться и загружать файлы в корень сайта. Об этом прочитайте Здесь .

На этом все! Жду отзывы.

Файл sitemap.xml и правильный robots.txt для сайта - это два обязательных документа, которые способствуют быстрому и полноценному индексированию всех необходимых страниц веб-ресурса поисковыми роботами. Правильная индексация сайта в Яндексе и Google - залог успешного продвижения блога в поисковых системах.

Как сделать карту сайта в формате XML и для чего она нужна я уже писал . А сейчас давайте поговорим о том, как создать правильный robots.txt для сайта на Вордпресс и для чего он вообще нужен. Подробную информацию об этом файле можно получить у самих Яндекса и Гугла, соответственно и . Я же коснусь самой сути и затрону основные настройки robots.txt для WordPress на примере своего файла.

Зачем нужен файл robots.txt для сайта

Стандарт robots.txt появился еще в январе 1994 года. Сканируя веб-ресурс, поисковые роботы в первую очередь ищут текстовый файл robots.txt, расположенный в корневой папке сайта или блога. С его помощью мы можем указать для роботов разных поисковых систем определенные правила, по которым они будут проводить индексацию сайта.

Правильная настройка robots.txt позволит:

- исключить из индекса дубликаты и различные мусорные страницы;

- наложить запрет на индексацию страниц, файлов и папок, которые мы хотим скрыть;

- вообще отказать в индексации некоторым поисковым роботам (например, Yahoo, чтобы скрыть от конкурентов информацию о входящих ссылках);

- указать главное зеркало сайта (с www или без www);

- указать путь к карте сайта sitemap.xml.

Как создать правильный robots.txt для сайта

Для этой цели существуют специальные генераторы и плагины, но правильнее это сделать вручную.

Надо просто создать обычный текстовый файл с названием robots.txt, воспользовавшись любым текстовым редактором (например, Блокнотом или Notepad++) и загрузить его на хостинг в корневую папку блога. В этом файле надо прописать определенные директивы, т.е. правила индексации для роботов Яндекса, Гугла и др.

Если лень заморачиваться с этим, то ниже я приведу пример, с моей точки зрения, правильного robots.txt для WordPress с моего блога. Можно использовать его, заменив имя домена в трех местах.

Правила создания и директивы robots.txt

Для успешной поисковой оптимизации блога надо знать некоторые правила создания robots.txt:

- Отсутствие или пустой файл robots.txt будет означать, что поисковикам разрешено индексировать все содержание веб-ресурса.

- robots.txt должен открываться по адресу ваш сайт.ru/robots.txt , отдавая роботу код ответа 200 OK и иметь размер не более 32 Кб. Файл, который не удастся открыть (например, из-за 404 ошибки) или большего размера, будет считаться разрешающим.

- Количество директив в файле не должно быть больше 1024. Длина одной строки – не более 1024 символов.

- Правильный файл robots.txt может иметь несколько инструкций, каждая из которых должна начинаться с директивы User-agent и должна содержать хотя бы одну директиву Disallow. Обычно пишут инструкции в robots.txt для Google и всех остальных роботов и отдельно для Яндекса.

Основные директивы robots.txt:

User-agent – указывает, какому поисковому роботу адресована инструкция.

Символ “*” означает, что это относится ко всем роботам, например:

User-agent: *

Если нам надо создать правило в robots.txt для Яндекса, то пишем:

User-agent: Yandex

Если указана директива для конкретного робота, директива User-agent: * ним не учитывается.

Disallow и Allow – соответственно, запрещают и разрешают роботам индексацию указанных страниц. Все адреса надо указывать от корня сайта, т.е. начиная с третьего слеша. Например:

- Запрет индексации всего сайта всем роботам:

User-agent: *

Disallow: / - Запрещено индексировать Яндексу все страницы, начинающиеся с /wp-admin:

User-agent: Yandex

Disallow: /wp-admin - Пустая директива Disallow разрешает индексировать все и аналогична Allow. Например, разрешаю индексировать Яндексу весь сайт:

User-agent: Yandex

Disallow: - И наоборот, запрещаю индексировать все страницы всем поисковым роботам:

User-agent: *

Allow: - Директивы Allow и Disallow из одного блока User-agent сортируются по длине префикса URL и выполняются последовательно. Если для одной страницы сайта подходит несколько директив, то выполняется последняя в списке. Теперь на использование директив роботом порядок их написания не имеет значения. Если у директив префиксы одинаковой длины, то первой выполняется Allow. Такие правила вступили в силу с 8.03.12 года. Например, разрешает индексировать только страницы начинающиеся с /wp-includes:

User-agent: Yandex

Disallow: /

Allow: /wp-includes

Sitemap – указывает адрес карты сайта XML. На одном сайте может быть несколько директив Sitemap, которые могут быть вложенными. Все адреса файлов Sitemap надо указать в robots.txt, чтобы ускорить индексацию сайта:

Sitemap: http://сайт/sitemap.xml.gz

Sitemap: http://сайт/sitemap.xml

Host – сообщает роботу-зеркальщику, какое зеркало сайта считать главным.

Если сайт доступен по нескольким адресам (например, с www и без www), то это создает полные дубли страниц, за которые можно попасть под фильтр. Также, в этом случае, может быть проиндексирована не основная страница, а основная, наоборот, будет исключена из индекса поисковой системы. Чтобы этого не допустить служит директива Host, которая предназначена в файле robots.txt только для Яндекса и может быть только одна. Пишется она после Disallow и Allow и выглядит так:

Host: сайт

Crawl-delay – задает задержку между закачкой страниц в секундах. Используется, если идет большая нагрузка и сервер не успевает обрабатывать запросы. На молодых сайтах лучше директиву Crawl-delay не использовать. Пишется она так:

User-agent: Yandex

Crawl-delay: 4

Clean-param – поддерживается только Яндексом и служит для устранения дубликатов страниц с переменными, склеивая их в одну. Тем самым робот Яндекса не будет много раз закачивать похожие страницы, например, связанные с реферальными ссылками. Я пока этой директивой не пользовался, но в помощи по robots.txt для Яндекса, по ссылке в начале статьи, можно ознакомиться с этой директивой подробно.

Спецсимволы * и $ используются в robots.txt для указания путей директив Disallow и Allow:

- Спецсимвол “*” означает любую последовательность символов. Например, Disallow: /*?* означает запрет на любые страницы, где в адресе встречается “?”, не зависимо от того, какие символы идут до и после этого знака. По умолчанию спецсимвол “*” добавляется к концу каждого правила, даже если он не прописан специально.

- Символ “$” отменяет “*” на конце правила и означает строгое соответствие. Например, директива Disallow: /*?$ будет запрещать индексацию страниц, заканчивающихся знаком “?”.

Пример robots.txt для WordPress

Вот пример моего файла robots.txt для блога на движке Вордпресс:

| User-agent: * Disallow: /cgi-bin Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Disallow: /trackback Disallow: */trackback Disallow: */*/trackback Disallow: /feed/ Disallow: */*/feed/*/ Disallow: */feed Disallow: /*?* Disallow: /?s= User-agent: Yandex Disallow: /cgi-bin Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Disallow: /trackback Disallow: */trackback Disallow: */*/trackback Disallow: /feed/ Disallow: */*/feed/*/ Disallow: */feed Disallow: /*?* Disallow: /?.ru/sitemap.xml..xml |

User-agent: * Disallow: /cgi-bin Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Disallow: /trackback Disallow: */trackback Disallow: */*/trackback Disallow: /feed/ Disallow: */*/feed/*/ Disallow: */feed Disallow: /*?* Disallow: /?s= User-agent: Yandex Disallow: /cgi-bin Disallow: /wp-admin Disallow: /wp-includes Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Disallow: /trackback Disallow: */trackback Disallow: */*/trackback Disallow: /feed/ Disallow: */*/feed/*/ Disallow: */feed Disallow: /*?* Disallow: /?.ru/sitemap.xml..xml

Чтобы не морочить себе голову с созданием правильного robots.txt для WordPress, можете использовать этот файл. Проблем с индексацией нет. У меня стоит скрипт защиты от копирования, поэтому будет удобнее готовый robots.txt скачать и загрузить его на свой хостинг. Только не забудьте заменить имя моего сайта на свое в директивах Host и Sitemap.

Полезные дополнения по правильной настройке файла robots.txt для WordPress

Если на вашем блоге Вордпресс установлены древовидные комментарии, то они создают дубли страниц вида ?replytocom= . В robots.txt такие страницы закрыты директивой Disallow: /*?* . Но это не выход и запреты лучше удалить, а с replytocom бороться другим способом. Каким, .

Таким образом, актуальный robots.txt на июль 2014 года выглядит так:

| User-agent: * Disallow: /wp-includes Disallow: /wp-feed Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes User-agent: Yandex Disallow: /wp-includes Disallow: /wp-feed Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Host: site.ru User-agent: Googlebot-Image Allow: /wp-content/uploads/ User-agent: YandexImages Allow: /wp-content/uploads/ Sitemap: http://site.ru/sitemap.xml |

User-agent: * Disallow: /wp-includes Disallow: /wp-feed Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes User-agent: Yandex Disallow: /wp-includes Disallow: /wp-feed Disallow: /wp-content/plugins Disallow: /wp-content/cache Disallow: /wp-content/themes Host: site.ru User-agent: Googlebot-Image Allow: /wp-content/uploads/ User-agent: YandexImages Allow: /wp-content/uploads/ Sitemap: http://site.ru/sitemap.xml

В нем дополнительно прописаны правила для роботов-индесаторов картинок.

User-agent: Mediapartners-Google

Disallow:

Если вы планируете продвигать страницы категорий или тегов, то стоит их открыть для роботов. Например, на блоге сайт рубрики не закрыты от индексации, так как в них публикуются только небольшие анонсы статей, что совсем незначительно в плане дублирования контента. А если использовать вывод цитат в ленту блога, которые заполнять уникальными анонсами, то дублирования вообще не будет.

Если вы не используете указанный выше плагин, то можно указать в файле robots.txt запрет индексации тегов, категорий и архивов. Например, добавив такие строчки:

Disallow: /author/

Disallow: /tag

Disallow: /category/*/*

Disallow: /20*

Не забудьте сделать проверку файла robots.txt в панели Яндекс.Вебмастер, после чего повторно загрузите его на хостинг.

Если у вас есть какие-то дополнения по настройке robots.txt, пишите об этом в комментариях. А сейчас посмотрите видео о том, что такое и как создать правильный robots.txt для сайта, как сделать в файле robots.txt запрет на индексацию и исправить ошибки.

Файл robots.txt это текстовой файл, в котором прописываются правила для поисковых машин для сканирования, а значит индексации папок и файлов сайта. Находится файл robots.txt должен в корневом каталоге сайта. Файл robots.txt наряду с это основные документы SEO оптимизации блогов сделанных на CMS WordPress.

Важно! Недопустимо пустые переводы строк между директивами User-agent и Disallow (Allow), а также между директивами Disallow и Allow .

Важно! URL файла robots.txt чувствителен к регистру.

На базовой версии файл robots.txt для wordpress выглядит следующим образом:

User-agent: Disallow: /wp-admin/ Disallow: /wp-includes/

- User-agent э то обращение к поисковикам. [*] звезда, означает, что следующие директивы группы обращены ко всем поисковикам;

- Директива Disallow запрещает поисковикам индексировать только то, что находится в папках /wp-admin/ и /wp-includes/.

Файл robots.txt составляется из строк, каждая из которых является отдельной директивой. Директива, а проще говоря, правило, пишется для поисковиков. Весь файл robots.txt пишется по специальному несложному синтаксису.

Синтаксис файла robots.txt

Символ ‘#’ назначен для комментариев. Все, что находится после решетки и до первого перевода строки не исполняется и не учитывается поисковиками.

Первой рабочей директивой файла robots.txt (начало группы) нужно прописывать директиву User-agent . Она показывает к кому поисковику относится следующие за ним директивы;

Недопустимо пустые переводы строк между директивами User-agent и Disallow (Allow);

Директива User-agent со звездой, то есть User-agent: * , означает, что правила robots.txt относятся ко всем поисковикам;

Для главных поисковых роботов Яндекс и Google директивы User-agent файла robots.txt должны выгладить так:

User-agent: Yandex User-agent: Googlebot

Правила для поисковиков прописываются директивами «Disallow» — запрет или «Allow»-разрешение;

User-agent: * Allow: /cgi-bin Disallow: / # запрещает скачивать все, кроме страниц # начинающихся с "/cgi-bin"

Любой файл robots.txt должен содержать директиву «Disallow»;

Пустая Disallow разрешает индексацию всего сайта, Disallow закрытая слеш (/) полностью закрывает сайт от индексации.

Disallow: / # блокирует доступ ко всему сайту

Составим Файл robots.txt для wordpresss

Что же стоит спрятать от поисковиков?

Разумно спрятать все папки с личной информацией, паролями, логинами и т.п. Это три папки. Директивы выглядят так:

User-agent: * Disallow: /cgi-bin/ Disallow: /wp-admin/ Disallw: /wp-includes/

Все плагины блога, темы, кэш не являются контентной информацией блога, поэтому их тоже спрячем.

Disallow: /wp-content/plugins/ Disallow: /wp-content/cache/ Disallow: /wp-content/themes/

В SEO продвижении, особенно в структуре WP, важное значение имеет отсутствие повторов (дублирование) контента в зоне одного домена. Дублирование возникает при редактировании материалов, при комментировании, при работе на блоге нескольких авторов, при постоянном упоминании одного автора в представлении к статье (имя автора). Много дублирования в тегах блога. Cтоит спрятать эти папки от поисковиков.

Disallow: /*?* Disallow: /*?

Таким же образом вы можете запретить индексацию любой папки или файла блога. Чтобы запретить индексацию файлов, например.pdf нужно прописать директиву:

Disallow: /*.pdf

Спецсимвол звезда ‘*’ означает любую, включая пустую, последовательность символов.

В файле robots.txt есть одна интересная директива специальная для Яндекс. Это директива Host. С помощью неё вы можете (должны) сообщить Яндекс основной домен (главное зеркало) своего блога. Директив Host в файле должна быть одна. Если внесены несколько директив Host читается первая по списку. Правда, для этого нужно сделать отдельную секцию для “User-agent” для Яндекс.

User-agent: Yandex

В файл robots.txt обязательно нужно вставить информацию о своей карте Sitemap

Карту-сайта нужно генерировать при помощи любого веб-инструмента Sitemap. Он генерирует четыре формата карты-сайта. Один из них, файл формата [.xml], сначала нужно загрузить в корень сайта, а потом включить в файл robots.txt. Если карт-сайта несколько загрузите все. Рекомендую два генератора Sitemap:

- https://pro-sitemaps.com/

- http://www.mysitemapgenerator.com/

Если вы видите большую загрузку своего сервера, то можно воспользоваться директивой «Crawl-delay». Она задаст время в миллисекундах, между загрузками двух страниц. Добавлять директиву «Crawl-delay» нужно сразу после “User-agent”.

User-agent: * Crawl-delay: 3.5 # задает таймаут в 3.5 секунды

Вообще менять файл robots.txt на сайте WordPress это работа творческая. Каждый файл robots.txt должен быть индивидуальным и отвечать вашим личным требованиям к поисковикам.

Файл robots.txt для wordpress: пример

Приведу, как мне кажется, разумный Файл robots.txt для wordpress. Закрываем от роботов, кроме всего прочего, рубрики (category), архивы автора (autor), и страница (page).

User-agent: *

Disallow: /cgi-bin

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

Disallow: /wp-content/cache/

Disallow: /wp-content/themes/

Disallow: /wp-trackback

Disallow: /wp-feed

Disallow: /wp-comments

Disallow: /category/

Disallow: /author/

Disallow: /page/

Disallow: */trackback

Disallow: */comments

Disallow: /*.php

Sitemap: http://ваш_сайт.ru/sitemap.xml.gz

Sitemap: http://ваш_сайт.ru/sitemap.xml

User-agent: Yandex

Disallow: /cgi-bin #блокирует доступ к страницам начинающихся с "/cgi-bin"

Disallow: /wp-admin/ #блокирует доступ к содержимому папки wp-admin

Disallow: /wp-includes/

Disallow: /wp-content/plugins/

#блокирует содержимое папки plugins в каталоге wp-content

Disallow: /wp-content/cache/

Disallow: /wp-content/themes/

Disallow: /wp-trackback #блокирует доступ к страницам начинающихся с wp-trackback

Disallow: /wp-feed

Disallow: /wp-comments

Disallow: /category/

Disallow: /author/

Disallow: /page/

Disallow: */trackback

Disallow: */comments

Disallow: /*.php

Host: ваш_сайт.ru

Sitemap: http://ваш_сайт/sitemap.xml

…мы отказываемся от директивы Host. Теперь эту директиву можно удалять из robots.txt, но важно, чтобы на всех не главных зеркалах вашего сайта теперь стоял 301-й постраничный редирект.

Пояснения к файлу

Этот файл robots.txt для wordpress содержит выделенную инструкцию для поисковика Яндекс. В эту часть файла добавлена специальная директива Host, которая читается только ботами Яндекс и определяет основное зеркало сайта. Двух директив Host в файле robots.txt быть не должно.

В этом примере файла robots.txt закрыто для поисковиков все содержание папок: wp-admin, wp-includes, plugins, cashe, themes, autor, category. Если не хотите закрывать от поисковиков архивы статей, авторов и категории уберите строки (директивы), которые я зачеркнул. Закрыта индексация страниц wordpress («на любителя»). Добавлены карты сайта.

Приведенный Файл robots.txt является частным и сделан для индивидуальных требований.

User-Agent: * Disallow: /wp-content/plugins/

Повторюсь и выделю, нет уникальных файлов robots.txt. Продумайте, что нужно именно вам закрыть от поисковиков или оставьте файл robots.txt для wordpress по умолчанию. Частые манипуляции с файлом robots.txt, будут лихорадить вашу выдачу в индексе поисковиков.

Полезные ссылки

- Robots для Google: https://developers.google.com/webmasters/control-crawl-index/docs/robots_txt?hl=ru

- Robots для Яндекс: https://yandex.ru/support/webmaster/controlling-robot/robots-txt.html#crawl-delay

На этом про файл robots.txt для wordpress почти всё!

Дополнения от Google 2019 года

01-07-2019 года Google объявил, что протокол robots.txt становится единым стандартом Интернет и в связи с этим, изменяются некоторые правила обработки Google файла robots.txt и правила его составления.

- Термин «запись» заменяется на общий термин «строка» или «правило».

- Google устанавливает максимальный размер файла robots.txt в 500 кибибайт (КиБ). Контент сверх этого лимита игнорируется. 1 кибибайт равен 1024 байта.

- Поисковик не обрабатывает элементы с простыми ошибками или опечатками.

- Роботы Гугл делают минимум 5 переходов в цепочке переадресаций, если файл robots.txt не удается получить сразу. Если в результате файл robots.txt не обнаруживается, роботы Google интерпретируют это как ошибку 404.

- Файл robots.txt должен располагаться в каталоге верхнего уровня хоста и быть доступным при использовании нужного протокола и номера порта. Google поддерживает все протоколы в том числе HTTP и HTTPS.

- URL файла robots.txt чувствителен к регистру.

- Формальный синтаксис файла robots.txt соответствует дополненной форме Бэкуса – Наура (ABNF) и включает символы UTF-8.

- Файл должен содержать обычный текст в кодировке UTF-8 и состоять из строк, разделённых символами CR, CR/LF или LF.

- Каждая действительная строка состоит из поля, двоеточия и значения. Использовать пробелы НЕ обязательно, но рекомендуется для удобства чтения.

- Комментарии можно размещать в любом месте файла, закрывая их символом #(решётка). После этого символа до конца строки контент расценивается как комментарий и игнорируется.

Дополнение

Интересен файл robots.txt от seogio.ru с очень подробными пояснениями.

User-agent: * # общие правила для роботов, кроме Яндекса и Google, # т.к. для них правила ниже Disallow: /cgi-bin # папка на хостинге Disallow: /? # все параметры запроса на главной Disallow: /wp- # все файлы WP: /wp-json/, /wp-includes, /wp-content/plugins Disallow: /wp/ # если есть подкаталог /wp/, где установлена CMS (если нет, # правило можно удалить) Disallow: *?s= # поиск Disallow: *&s= # поиск Disallow: /search/ # поиск Disallow: /author/ # архив автора Disallow: /users/ # архив авторов Disallow: */trackback # трекбеки, уведомления в комментариях о появлении открытой # ссылки на статью Disallow: */feed # все фиды Disallow: */rss # rss фид Disallow: */embed # все встраивания Disallow: */wlwmanifest.xml # xml-файл манифеста Windows Live Writer (если не используете, # правило можно удалить) Disallow: /xmlrpc.php # файл WordPress API Disallow: *utm*= # ссылки с utm-метками Disallow: *openstat= # ссылки с метками openstat Allow: */uploads # открываем папку с файлами uploads User-agent: GoogleBot # правила для Google (комментарии не дублирую) Disallow: /cgi-bin Disallow: /? Disallow: /wp- Disallow: /wp/ Disallow: *?s= Disallow: *&s= Disallow: /search/ Disallow: /author/ Disallow: /users/ Disallow: */trackback Disallow: */feed Disallow: */rss Disallow: */embed Disallow: */wlwmanifest.xml Disallow: /xmlrpc.php Disallow: *utm*= Disallow: *openstat= Allow: */uploads Allow: /*/*.js # открываем js-скрипты внутри /wp- (/*/ - для приоритета) Allow: /*/*.css # открываем css-файлы внутри /wp- (/*/ - для приоритета) Allow: /wp-*.png # картинки в плагинах, cache папке и т.д. Allow: /wp-*.jpg # картинки в плагинах, cache папке и т.д. Allow: /wp-*.jpeg # картинки в плагинах, cache папке и т.д. Allow: /wp-*.gif # картинки в плагинах, cache папке и т.д. Allow: /wp-admin/admin-ajax.php # используется плагинами, чтобы не блокировать JS и CSS User-agent: Yandex # правила для Яндекса (комментарии не дублирую) Disallow: /cgi-bin Disallow: /? Disallow: /wp- Disallow: /wp/ Disallow: *?s= Disallow: *&s= Disallow: /search/ Disallow: /author/ Disallow: /users/ Disallow: */trackback Disallow: */feed Disallow: */rss Disallow: */embed Disallow: */wlwmanifest.xml Disallow: /xmlrpc.php Allow: */uploads Allow: /*/*.js Allow: /*/*.css Allow: /wp-*.png Allow: /wp-*.jpg Allow: /wp-*.jpeg Allow: /wp-*.gif Allow: /wp-admin/admin-ajax.php Clean-Param: utm_source&utm_medium&utm_campaign # Яндекс рекомендует не закрывать # от индексирования, а удалять параметры меток, # Google такие правила не поддерживает Clean-Param: openstat # аналогично # Укажите один или несколько файлов Sitemap (дублировать для каждого User-agent # не нужно). Google XML Sitemap создает 2 карты сайта, как в примере ниже. Sitemap: http://site.ru/sitemap.xml Sitemap: http://site.ru/sitemap.xml.gz # Укажите главное зеркало сайта, как в примере ниже (с WWW / без WWW, если HTTPS # то пишем протокол, если нужно указать порт, указываем). Команда стала необязательной. Ранее Host понимал # Яндекс и Mail.RU. Теперь все основные поисковые системы команду Host не учитывают. Host: www.site.ru

Заключение

Файл robots.txt для wordpress создаётся под конкретный сайт и конкретные задачи. Приведенные примеры файлов лишь дают представление, как файл составить и это рекомендации по его составлению. Хотя рекомендации правильные и заслуживают внимания.

Например, вот такой robots.txt используют на сайте ru.wordpress.org:

User-agent: * Disallow: /wp-admin/ Allow: /wp-admin/admin-ajax.php User-agent: * Disallow: /search Disallow: /support/rss Disallow: /archive/